生成AIの普及により、若手の人材育成に課題を感じていませんか?AIを活用しても成長につながらない――そんな現場の悩みが、企業や自治体で急速に広がっています。

「AIがあるから、とりあえず出力を使えばいい」「とりあえずコピペして動いたから問題ない」

こうした声が象徴するように、2025年から2026年にかけて、生成AIの社会実装は「試行」から「常用」へと移行しました。しかしその裏側で、ある深刻な問題が静かに進行しています。

それは、「理解できない人材」が増えているという現実です。Microsoftのエンジニアとして活躍する牛尾剛氏が提唱する「理解をスキップするのにAIを使うのはもったいない。理解するためにAIを使え。理解が何よりも大切」という視点は、この問題の本質を突いています。

本記事では、企業経営者や自治体関係者に向けて、AI時代における若手育成の本質と、現場で優先すべき具体的な取り組みを論理的に整理します。

なぜ今「理解力」が重要なのか?

AIが普及した今、なぜ人間の「理解力」が重要なのでしょうか。

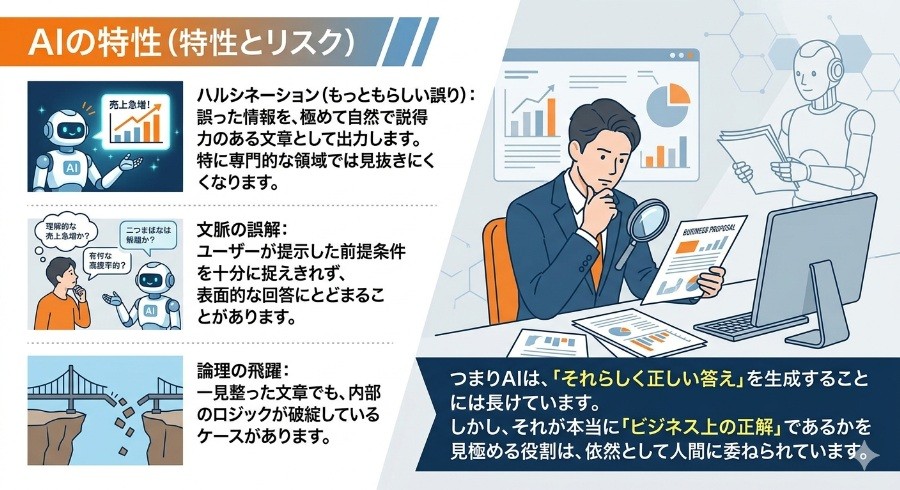

その理由は、AIが「論理的な正当性を保証しない」からです。2026年現在、OpenAIのo1シリーズやAnthropicのClaude 3.5/4といったモデルは高度な推論能力を備えていますが、依然としていくつかの本質的な限界を抱えています。

たとえば、以下のような特性です。

- ハルシネーション(もっともらしい誤り):誤った情報を、極めて自然で説得力のある文章として出力します。特に専門的な領域では見抜きにくくなります。

- 文脈の誤解:ユーザーが提示した前提条件を十分に捉えきれず、表面的な回答にとどまることがあります。

- 論理の飛躍:一見整った文章でも、内部のロジックが破綻しているケースがあります。

つまりAIは、「それらしく正しい答え」を生成することには長けています。しかし、それが本当に「ビジネス上の正解」であるかを見極める役割は、依然として人間に委ねられています。

理解力が不十分なままAIに依存すると、誤ったアウトプットを採用してしまったり、問題の本質を見誤ったりするリスクが高まります。その結果、短期的には効率が上がったように見えても、長期的には組織全体の生産性を大きく損なう可能性があります。

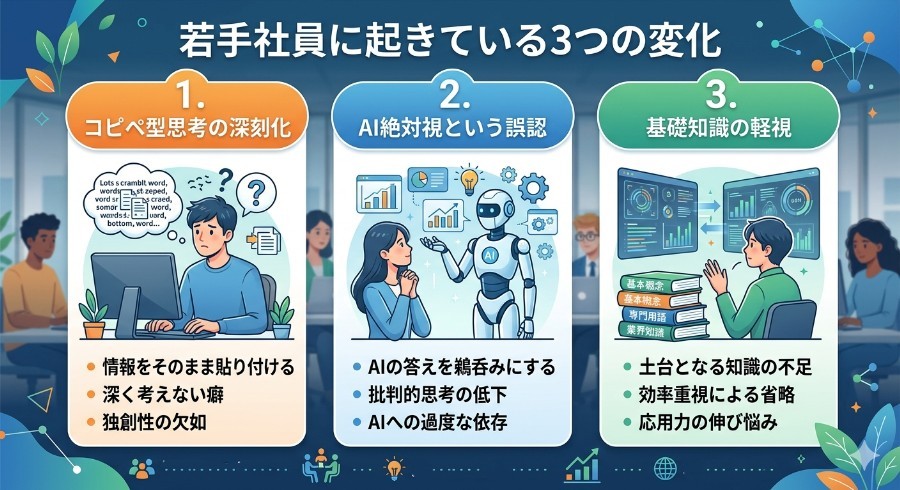

若手社員に起きている3つの変化

AIの普及は業務効率を高める一方で、若手社員の思考プロセスそのものに変化をもたらしています。とりわけ見過ごせないのは、「考えなくても仕事が進んでしまう環境」が定着しつつある点です。ここでは、その具体的な変化を3つに分けて見ていきます。

1.コピペ型思考の深刻化

AIに24時間問いかけることができる環境下で、「理解を深める」のではなく「作業を終わらせる」ためにAIを使う行動が常態化しています。従来の検索エンジンは情報の断片を提示するだけでしたが、AIは「完成形」を出力します。このため、若手が思考プロセスを完全にバイパスしてしまうリスクは、検索時代よりも格段に高まっています。

2.AI絶対視という誤認

「AIが回答したのだから正しいはずだ」という無批判な受容が見られます。最新のAIは確率論的に次の単語を予測しているに過ぎず、真実を理解しているわけではありません。この誤認は、検証作業の放棄や多角的な視点の欠如を招き、若手の思考力そのものを削ぎ落としてしまいます。

3.基礎知識の軽視

「AIが代替してくれるから基礎学習は不要」という極論も一部で見られますが、事実は逆です。AIが出力したコードの脆弱性や、法的なリスク、倫理的な違和感を見抜くには、体系的な基礎知識が不可欠です。基礎が欠落した人材にとって、AIは補助ツールではなく、リスクの源泉となります。

AI時代の育成方針:「禁止」ではなく「段階設計」

AIを禁止すべきか、それとも自由に使わせるべきか。

2026年のビジネス環境において、AIの利用を全面的に禁止することは現実的ではありません。一方で、無制限に自由に使わせるだけでは、育成の機会を手放してしまうことにもつながります。重要なのは、若手の習熟度に応じてAIの関与度をコントロールする「段階設計」にあります。

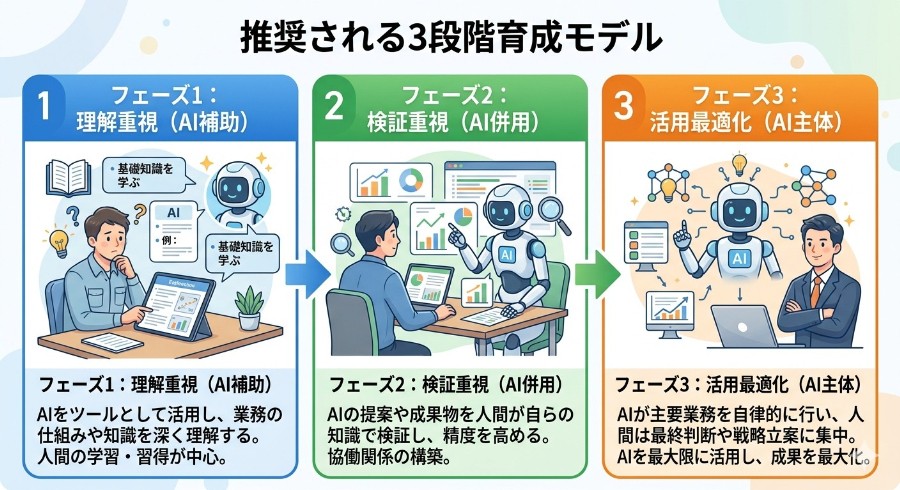

推奨される3段階育成モデル

AIの使い方を誤ると、思考力の低下を招きかねません。そこで重要になるのが、「どの段階で、どのようにAIを使わせるか」を明確に設計することです。以下に推奨される3つのフェーズを示します。

フェーズ1:理解重視(AI補助)

まずは自力で思考し、自らの限界を認識した上で、わからない部分だけをAIに質問させます。ここではAIを「答えを出す道具」ではなく「思考を助けるチューター」として位置づけます。

フェーズ2:検証重視(AI併用)

AIの出力を鵜呑みにせず、必ず複数の情報源と照合し、別の手法と比較検討させます。ここでは「AIの品質を評価し、修正する力」を養います。

フェーズ3:活用最適化(AI主体)

AIを前提とした業務プロセスの再構築や、高度なプロンプトエンジニアリングを実践します。基礎力が固まった段階で初めて、圧倒的な効率化を追求させます。

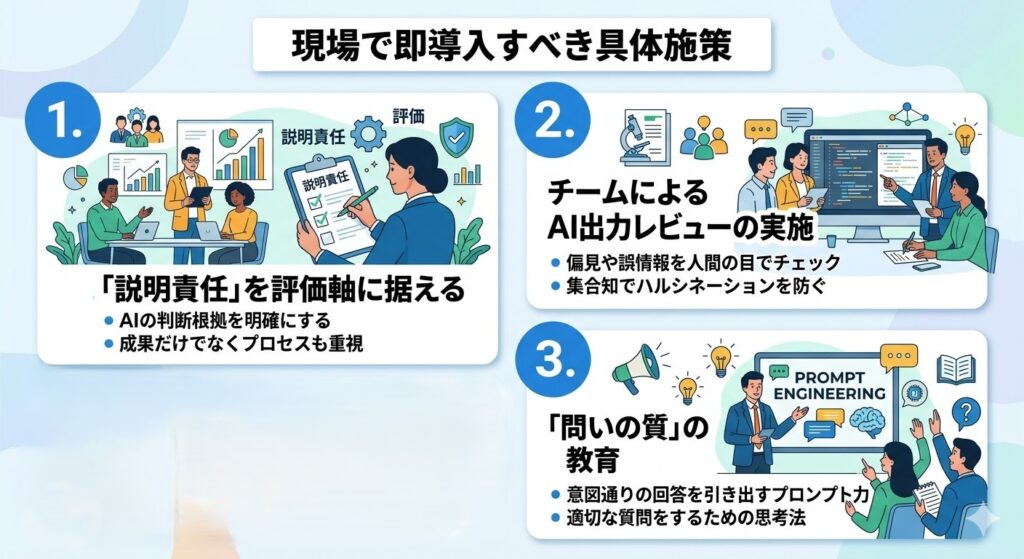

現場で即導入すべき具体施策

ここまで見てきた課題と育成方針を踏まえ、現場で今すぐ実践できる具体的な施策を紹介します。いずれも特別なツールや大きな投資を必要とせず、日々の業務の中で導入可能なものです。

1.「説明責任」を評価軸に据える

AIを使用して作成された成果物に対し、上司は必ず「なぜこの結論に至ったのか、プロセスを説明してください」と問いかけてください。論理的な説明ができない場合は、未習熟と判断し、再度思考を促す文化が必要です。

2.チームによるAI出力レビューの実施

AIの回答のどこが優れており、どこにリスクが潜んでいるかをチームで議論します。他者の視点を入れることで、AIの癖や自身のバイアスに気づくトレーニングになります。

3.「問いの質」の教育

AI活用の成果はプロンプト(問い)の質に直結します。前提条件の明確化、目的の具体化、制約条件の付与といった「言語化能力」を鍛えることは、そのままビジネススキルの向上につながります。

自治体・中小企業が直面するリスク

この問題は、地方や中小企業にどのような影響を与えるのでしょうか。

地方自治体や中小企業にとって、この問題は単なる人材育成の課題ではなく、経営や行政運営に直結する重要テーマです。大企業と比べて教育リソースや採用力が限られる中で、「理解できない人材」が増加すると、DX(デジタルトランスフォーメーション)は形だけのものとなり、次のような負の連鎖を引き起こします。

- 外部ベンダーへの過度な依存

- 内製化が進まないことによるコストの増大

- トラブル発生時における対応力の低下

こうした状況を避けるためには、「AIを使える」だけの人材では不十分です。「AIを理解し、適切に制御できる」人材を地域内で育成できるかどうかが、今後の地域競争力を大きく左右します。

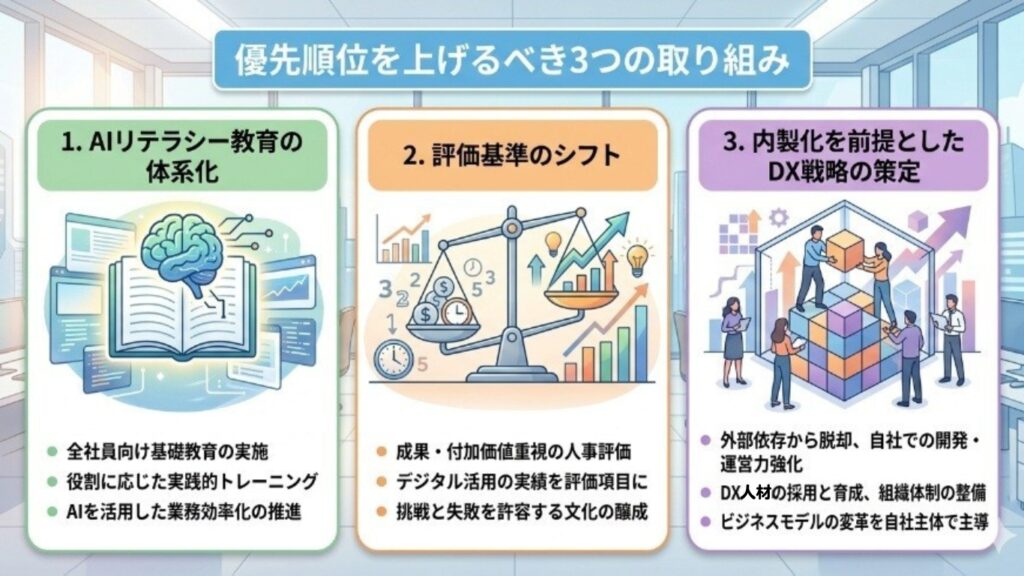

今、優先順位を上げるべき3つの取り組み

こうしたリスクを踏まえると、AI時代における人材育成と組織づくりは、後回しにできない経営課題です。ここでは、特に優先順位を高めて取り組むべき3つのポイントを整理します。

1.AIリテラシー教育の体系化

ツールの操作方法を教えるだけの研修を卒業し、AIの原理的限界、バイアスの存在、情報の検証方法までを含めた体系的な教育プログラムを構築してください。

2.評価基準のシフト

成果物の「速さ」や「見た目」だけで評価するのではなく、その背後にある「理解の深さ」や「判断の根拠」を重視する評価制度への転換が求められます。

3.内製化を前提としたDX戦略の策定

AIを単なる省力化手段として捉えるのではなく、自社・自組織で改善や応用ができる「知的基盤」を構築することを戦略の柱に据えてください。その中心には、常に「理解力のある人材」がいなければなりません。

まとめ

AIは強力なツールですが、使い方を誤れば組織の知的体力を奪います。重要なのは、AIに「考えさせる」のではなく、AIを使って「人間がより深く考える」環境を作ることです。

牛尾剛氏の言葉が示す通り、理解をスキップするためではなく、理解するためにAIを使う。この原則を組織として徹底できるかどうかが、不確実な時代の勝敗を分けます。短期的な効率化という誘惑に負けず、長期的な人材価値の最大化を見据えた「理解優先」の意思決定が、今、求められています。

中小企業自治体DXニュース編集部です。

本メディアは、中小企業経営者や自治体関係者に向けて、補助金・資金調達・DX・業務改革などの分野に関する実務情報を発信するビジネスメディアです。

編集部には、金融機関、ベンチャーキャピタル、経営企画、新規事業開発、DXコンサルティングなどの分野で実務経験を持つメンバーが参画。スタートアップ投資、企業の資金調達支援、SaaS企業のマーケティング支援、自治体・大学との産学官連携プロジェクトなど、多様な事業支援の現場で得た知見をもとに記事制作を行っています。

また、地域企業のDX支援や新規事業の立ち上げ、産学官連携による地域プロジェクトなどに携わってきた経験を活かし、現場視点での情報整理と解説を重視しています。

記事制作には、外資系IT企業、SaaS企業、AIスタートアップ、技術系ベンチャーなどで事業開発・マーケティングを担当する専門ライターや編集者が参加し、専門性と実務性の両立を重視しています。

中小企業や地域社会の持続的な成長に貢献する情報発信を目指しています。